基于改进Faster-RCNN,算法的地铁车辆车侧下结构检测识别

陈金源,林群煦,邹一鸣,郑衡,刘凯,钟程,李虎,黄挺博,李鹏

(五邑大学 轨道交通学院,广东 江门 529020)

地铁车辆的检修关乎出行安全,其巡检范围分别为车顶、车侧中、车侧下和车底.目前地铁车辆检修的主要作业方式为传统的人工巡检,该方式存在效率低、工人劳动强度大、漏检等问题[1].为了提高巡检效率、降低工人劳动强度、杜绝漏检,以地铁车辆车侧下巡检为例,可以通过目标检测算法[2]对采集到的地铁车辆车侧下的图像进行处理后,输出检测识别的地铁车辆车侧下的关键结构,让工人在线上对所识别出来的结构一一进行检查,以达到线上巡检的目的.线上巡检因高效和便利的特性已在各行各业应用[3].为了实现线上实时巡检,要求使用的目标检测算法具有实时检测的效果,由于地铁车辆车侧下外形结构比较复杂,传统的目标检测算法[4]不能准确检测识别,本文采用改进的深度学习Faster-RCNN 算法作为地铁车辆车侧下各结构的目标检测算法.

1.1 Faster-RCNN 算法的发展

Faster-RCNN 算法[5]由GIRSHICK R 于2015 年提出,相比前作Fast-RCNN,使用RPN(Region Proposal Network)结构代替SS(Selective search)算法来生成区域候选框,将整个流程统一整合到同一个CNN(Convolutional Neural Network)中以实现整个目标检测网络端到端的训练.

虽然Faster-RCNN 性能优越,但依然存在训练时间长、整体模型参数量大、对计算设备要求高等问题.为了提升 Faster-RCNN 的检测速度、降低训练过程中模型的参数量,不少学者对Faster-RCNN 的特征提取网络VGG16 进行了替换,如WIBOWO A 等[6]提出把原Faster-RCNN 特征提取网络替换为更加轻量的网络模型MobileNetV2(其网络参数量只有VGG16 的三十二分之一);

殷小芳等[7]提出用ResNet-101 网络作为Faster-RCNN 的特征提取网络,并首次实现超深的网络结构,首次提出了残差模块(Residual)、使用BN(Batch Normalization)层来加速训练;

唐茂俊等[8]在殷小芳的基础上增加了FPN(feature pyramid network)特征金字塔网络,把原Faster-RCNN 特征提取网络由一层特征层输出层改为五层特征层输出层,以此增加Faster-RCNN 对小目标的检测能力.

1.2 Faster-RCNN 算法的改进

MobileNetV2 网络推理速度快、参数少,但有一定的精度损失;

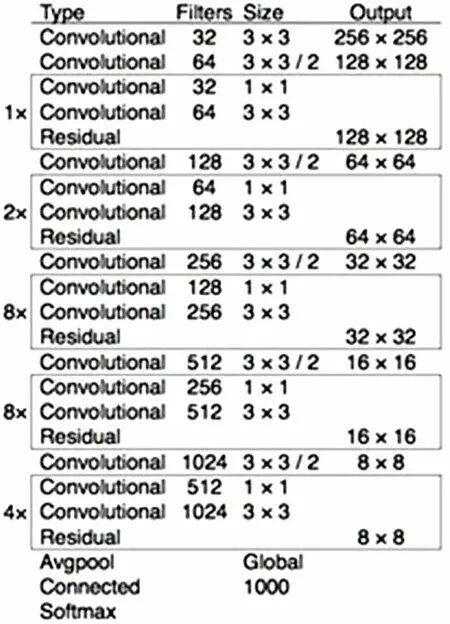

ResNet-101 网络检测精度高,但是推理速度慢、参数多,均不符合本文地铁车辆车侧下的结构检测识别要求.鉴于此,本文采用 YOLOV3 的特征提取网络 DarkNet53 作为Faster-RCNN 的特征提取网络,并在特征输出层加入FPN 特征金字塔网络,DarkNet53 网络模型结构如图1 所示.

图1 DarkNet53 网络结构模型图

DarkNet53 中的卷积层Convolutional 层与普通的神经网络卷积层不一样,其结构如图2 所示.普通卷积层需要通过增加偏置来增加学习能力,而Convolutional 层中的卷积层经过BN 层后则不需要再增加偏置.BN 层会将每层的输入先进行归一化,解决网络训练中中间层数据分布发生改变的问题,避免梯度消失或爆炸,从而节约训练时间.下面给出两个公式:公式(1)表示在BN 层下d维向量输入,公式(2)表示每一维的运算过程:

图2 Convolutional 结构模型图

式中,E[x(k)]为数学期望,Var[x(k)]为方差[7].而激活函数也从ReLU 激活函数改成了LeakyReLU激活函数.Residual 残差层结构跟ResNet-101 的残差结构也有一定的区别,其结构如图3 所示.在DarkNet53 网络中取消了最大池化层,改为Convolutional 层进行接替,这样可以加快整体网络的训练速度.

图3 Residual 结构模型图

2.1 实验环境

本文实验采用的硬件配置为:2.2 GHz E5-25650 v4 CPU,NVIDIA GTX1080Ti 显卡,128 Gb 内存,2 Tb 硬盘;

服务器配置系统使用Ubuntu 16.04 版本,CUDNN 7.6 版本,CUDAToolkit 10.2 版本;

深度学习框架平台为Pytorch 1.7 版本.

2.2 实验数据集

地铁车辆车侧下一共有18 个需要检测的结构(以深圳地铁7 号线车型为例),由于篇幅限制这里只展示其中两节车厢以及5 个结构.地铁车辆车侧面如图4 所示,其中红色框表示地铁车辆需要检测的车侧下位置,黄色框表示车头结构,蓝色框表示转向架结构,绿色框表示风缸结构,白色框表示制动电阻箱结构,棕色框表示贯通道结构.

图4 地铁车辆车侧面

本实验的数据集源自深圳地铁7 号线深云车辆段现场采集,线扫相机原始采集的图像为1 024 ×4 096,包含的目标显示信息不足,如图5 所示,为了完整清晰显示目标类别,需要对原始图像按照一定的步长进行拼接,如图6 所示.

图5 原始数据图像

图6 拼接后的数据图像

拼接后共有2 000 多张图片,为了提高模型的泛化能力和鲁棒性,采用翻转、旋转、增加噪声和变换图像的增强方法扩充样本图像至5 000 多张.其中70%用于训练集,20%用于验证集,10%用于测试集.

在开始训练之前,先对本文改进模型的超参数进行配置,初始学习率(Learning Rate)为0.01,动量(Momentum)为0.9,权重衰减(Weight Decay)为0.000 5,优化器(Optimizer)采用随机梯度下降法SGD,训练次数设置为1 000 个epochs.

3.1 评价指标

在评估模型时,需要一定的评价指标对模型性能进行评估,通过计算精确度(Precision)、召回率(Recall)、平均精度AP(Average Precision)、均值平均精度mAP(Mean Average Precision)、置信度(Confidence coefficient)、模型的参数个数以及检测速度FPS(Frames Per Second)(参数个数越多网络检测速度越慢,FPS 越大检测速度越快).

3.2 结果分析

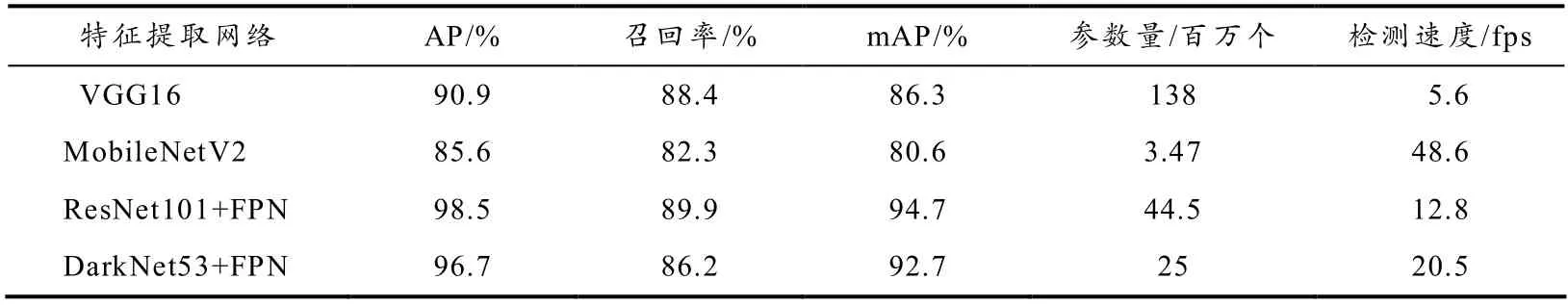

在改进的Faster-RCNN 算法中,Anchors 设置的scales 大小为128、256、512 等三个尺度.为增加对小目标的检测能力,本文再增加两个尺度,使Anchors 的scales 大小为32、64、128、256、512一共五个尺度.加入FPN 的分层预测,可以提高Faster-RCNN 对小目标的检测精度[9].对比4 种不同的特征提取网络,结果如表1 所示.

表1 4 种特征提取网络参数对比

由表1 可知:1)MobileNetV2 网络检测速度最快,参数量最少(VGG16 的三十分之一都不到),十分轻量化;

但其精确度和召回率以及均值平均精度都较低.2)DarkNet53+FPN 网络相比VGG16网络,精确度、召回率分别提高近了8%,检测速度提高了接近4 倍;

相比MobileNetV2 网络,其精确度、召回率分别提高了近13%,但检测速度不到其一半;

相比ResNet101+FPN 网络,其精确度、召回率分别降低了近3%.虽然与ResNet101+FPN 网络相比,精确度和召回率有少许下降,但其整体参数量比ResNet101+FPN 网络少了一半,检测速度提升接近一倍.

选择包含大中小目标的测试图片对4 种特征提取网络进行测试,其结果如图7~10 所示:1)对于小目标ACM 电抗器箱和中目标高压箱,MobileNetV2 网络存在一定的漏检而且检测效果不好;

VGG16 的边界框回归效果虽好,但对小目标ACM 电抗器箱也一样存在目标漏检;

2)ResNet101+FPN网络和DarkNet53+FPN 网络对于大目标AB 箱、中目标高压箱以及小目标ACM 电抗器箱都可以成功检测,但 DarkNet53+FPN 检测每个目标的置信度明显高于 ResNet101+FPN 网络.证明了DarkNet53+FPN 作为特征提取网络无论在精度上和模型参数上都比其他三种特征提取网络更适用于地铁车辆车侧下的结构检测.

图7 VGG16 网络检测结果

图8 MobileNetV2 网络检测结果

图9 ResNet101+FPN 网络检测结果

图10 DarkNet53+FPN 网络检测结果

目前基于深度学习的目标检测方法主要分为两类:一类为Two-stage 方法,该方法把检测分为定位和分类两个步骤,主要算法以RCNN、Fast-RCNN、Faster-RCNN 等为代表[10];

而另一类One-stage方法则直接将定位和分类融合在一起,代表算法有YOLO、SSD、Retina-Net 等[11].Two-stage 方法识别准确度较高,但很难做到实时检测;

One-stage 方法检测速度高,但识别精度较低.

为了进一步对改进Faster-RCNN 算法的检测性能进行评估,本文选用YOLOV3 算法和SSD 算法这两种One-stage 方法对相同数据集进行同步训练,训练的超参数与Faster-RCNN 相同.训练结果对比如表2 所示:改进的Faster-RCNN 其均值平均精度最高,检测速度最慢.伍锡如等[12]在汽车仪表检测中单张图片检测速度为0.197 s(约6.3 fps),能满足实时检测要求.而本文改进的Faster-RCNN算法检测识别速度为20.5 fps,已经满足地铁车辆车侧下结构实时检测识别的要求.因此,本文改进的 Faster-RCNN 算法作为一种 Two-stage 方法,在保持很高的检测精度的情况下,也能实现与One-stage 中YOLOV3 算法和SSD 算法一样的实时检测.

表2 不同算法对比结果

为了降低工人的劳动强度、提升地铁车辆的检修效率,本文提出了一种基于改进 Faster-RCNN算法对地铁车辆车侧下需要检测的结构进行检测识别.试验结果表明通过改进Faster-RCNN 算法的特征提取网络对地铁车辆车侧下各结构的识别有很好的提升效果,检测均值平均精度mAP 可达到92.7%,检测速度可达到20.5 fps,拥有比One-stage 方法更高的检测精度,能达到与One-stage 方法一样的实时检测效果,成功实现了从人工线下巡检到人工线上巡检.不足之处是该算法暂时无法识别每个结构的表面异常,如螺栓缺失、零件损坏以及表面脱落等问题,后续会针对这些不足继续完善算法模型.

猜你喜欢 特征提取车辆结构 《形而上学》△卷的结构和位置哲学评论(2021年2期)2021-08-22论结构中华诗词(2019年7期)2019-11-25空间目标的ISAR成像及轮廓特征提取北京航空航天大学学报(2019年9期)2019-10-26基于Gazebo仿真环境的ORB特征提取与比对的研究电子制作(2019年15期)2019-08-27基于特征提取的绘本阅读机器人设计方案电子制作(2019年15期)2019-08-27基于Daubechies(dbN)的飞行器音频特征提取电子制作(2018年19期)2018-11-14车辆小太阳画报(2018年3期)2018-05-14冬天路滑 远离车辆阅读与作文(小学低年级版)(2016年12期)2016-12-22论《日出》的结构影视与戏剧评论(2016年0期)2016-11-23提高车辆响应的转向辅助控制系统汽车文摘(2015年11期)2015-12-02上一篇:关于发展警察体能训练的思考

下一篇:油气开发再现小阳春