基于多维匹配距离融合的指节纹识别

黄 杰,魏 欣,杨子元,闵卫东,3

基于多维匹配距离融合的指节纹识别

黄 杰1,魏 欣2,杨子元1,闵卫东2,3

(1. 南昌大学信息工程学院,江西 南昌 330031;

2. 南昌大学软件学院,江西南昌 330047;

3. 江西省智慧城市重点实验室,江西 南昌 330047)

指节纹识别(FKP)作为一种新型的生物特征识别方式,以其安全性和稳定性而备受关注。基于编码的方法被认为是该领域最有成效法之一,在模板匹配阶段通常根据所提取的特征信息计算出2张图片之间的匹配距离来判断样本。然而,一些模糊样本无法通过单一的匹配距离进行有效区分,从而导致较高的错误接受率和错误拒绝率。针对这一问题,提出了一种轻量化且有效的多维匹配距离融合方法。主要思想是基于多种编码方法中不同匹配距离之间的差异性和互补性,利用支持向量机(SVM)对多种匹配距离所构造出的多维特征向量进行分类。其具有极强的通用性,易嵌入到现有的基于编码的方法中。在公开的指节纹数据库PloyU-FKP上进行了从二维到四维匹配距离的大量实验。结果表明,该方法能够普遍提高认证的性能,EER最多可降低22.19%。

指节纹识别;

多维匹配距离;

差异互补;

支持向量机;

通用性

在网络化信息社会,许多场合需要准确地识别一个人身份,生物特征技术为身份识别提供了有效地解决方案[1-2]。目前常用的生物特征包括面部、虹膜、指纹和掌纹[3-4]。指节纹作为一种重要的生物特征,具有信息丰富、限制少、保密性好、成本低等特点,也逐渐进入了研究者的视线。指节纹的研究始于2004年,并在近十年来取得了丰硕的成果[5-6]。

现有的编码类指节纹识别(finger-knuckle- print,FKP)方法在模板匹配阶段大多使用单一的匹配距离判断2幅图像是否属于同一个人。但是,对于部分模糊样本,单一匹配距离无法对其进行准确地区分,从而导致较高的错误接受率和错误拒绝率。因此,通过单一匹配距离认证身份的方式不具有足够的辨别力。本文提出了一种基于多维匹配距离融合的轻量化方法,基于多种特征提取算法,利用不同特征空间所计算出匹配距离之间的差异性和互补性。该方法在模板匹配阶段将不同的匹配距离构造成多维匹配距离向量再用支持向量机(support vector machine,SVM)进行分类以缓解现有方法识别精度不足的问题。其核心思想是将单一匹配距离扩展为多维匹配距离,使单一匹配距离无法识别的模糊样本能够通过多维匹配距离被准确识别,能够嵌入到各种编码类方法中,无论是现存的,还是未来即将出现的,其具有极强的通用性。

在特征提取阶段,深度学习通常需要大量地训练样本调整网络中的参数,实际应用中一般很难获取用户大量的手指图像,因此会导致深度学习方法不适用[7]。本文方法在匹配分类阶段仅涉及二维到四维的特征(与匹配距离的个数相对应)。传统的分类器,如SVM能实现理想的效果,无需通过深度神经网络(deep neural network,DNN)进行分类。此外,SVM相对DNN而言,无需存储大量参数且计算成本低。综上,本文方法采用SVM分类器完成最终的分类。

1.1 指节纹识别流程及相关进展

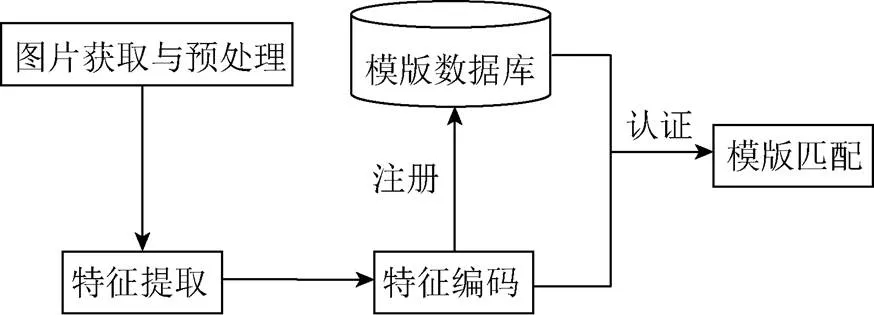

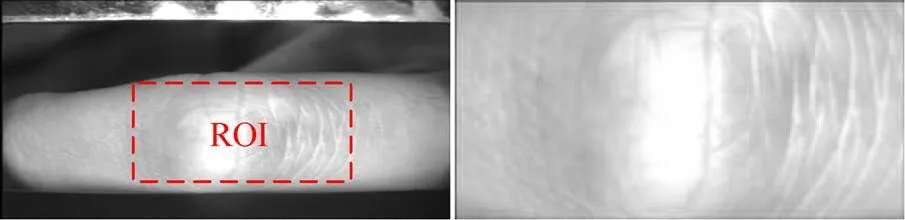

FKP框架通常由图片采集、预处理、特征提取和模板匹配4部分组成。其通用流程如图1所示。同时,图2展示了指节纹图片感兴趣区域(region of interest,ROI)的裁剪。

图1 基于指节纹的个人认证系统的结构

图2 图像ROI提取

近年来,越来越多的算法表现出高精度、抗光照变化鲁棒性、特征提取和匹配速度快等优点[8]。LI等[9]首先提出了内指指关节模式识别框架,包括内指指关节模式预处理和识别算法,充分展示了整个识别过程。YANG等[10]利用二维Gabor滤波器提取图像局部方向和角距离信息,以衡量2个竞争码映射之间的相似性,该算法被称为竞争编码(Comp)。SUN等[11]提出了对2个方向正交的线性图像区域进行比较的新方法,然后生成一位特征码,称之为序数码。XU等[12]提出了一种基于判别性和鲁棒竞争码的方法(discriminative robust competitive code,DRCC),可对邻域的方位信息进行加权,提高了优势方向码的精度和稳定性。ZHANG等[13]利用Gabor滤波的方向信息和幅值信息相结合的特征提取方案,是一种改进竞争码并融合幅度码的算法。ZHANG和LI[14]则利用Riesz变换对生物特征图像的局部模式进行编码的方法,提出了2种Riesz变换编码方案,即RCode1和RCode2,使用3位表示每一个编码,并采用归一化Hamming距离进行匹配。GUO等[15]提出了一种将图像与6个不同方向的Gabor滤波器实部卷积的响应进行二值化的编码方法,并将其命名为BOCV,能够较好地描述局部方向特征,对图像旋转具有较强的鲁棒性。卷积神经网络(convolutional neural network,CNN)与传统的基于编码的方法一样,在计算机视觉任务中具有显著的性能,因此CNN也开始被应用于FKP的特征提取中[16-17]。然而,CNN需要大量的数据来训练模型。相比之下,基于编码的方法具有计算复杂度低、存储成本低、参数少、速度快等优点。

1.2 特征提取滤波器

Gabor滤波器可以从图像中提取3种类型的特征——幅度、相位和方向,这些特征可以在不同的情况下单独使用或联合使用[18]。本文采用的方法均利用Gabor滤波器提取指节纹特征,即

本节介绍了一维匹配距离到多维匹配距离的原理分析和本文方法的总体流程。图3为本文方法的认证流程图。

2.1 单一匹配距离到多维匹配距离的原理分析

编码类方法往往是在特征提取和编码阶段之后,通过计算2幅模板之间的匹配距离对用户身份进行判断。由于单一方法匹配距离的鉴别性不足,其存在大量模糊区间。为了减少歧义并方便后续的描述,首先对相关概念进行定义:一对图片之间的一维或多维匹配距离向量在向量空间可以视为一个新的样本点。如果一对图片属于同类,则称其之间的匹配距离向量所对应的样本为类内样本;

如果一对图片属于不同类,则称其之间的匹配距离向量所对应的样本为类间样本。图4为类内、类间样本分布图,模糊样本存在类内和类间的重叠区域。

图3 本文方法的认证流程图

图4 类内、类间和模糊样本分布图

模糊样本的出现主要是因为噪声的影响和特征提取算法本身的缺陷,部分类内样本的匹配距离会偏大,而部分类间样本的匹配距离会偏小。这些因素都将导致类内和类间样本的匹配距离分布出现重叠。因此,单一阈值无法准确区分这些模糊样本,图5可以更加直观地阐释上述内容。

受单一匹配距离局限性的启发,本文将多种匹配距离融合成多维匹配距离向量提高模板匹配阶段的性能。不同的特征算法可以学习到不同的特征,其匹配距离也存在差异。因此,不同算法所计算的匹配距离具有一定的差异性和互补性,可以将其视为样本的不同特征,并将其结合成匹配距离向量,再利用SVM进行分类。以二维匹配距离为例,如图6所示,二维匹配距离判决错误的样本数小于单一匹配距离判决错误的样本数。这是因为不同特征提取算法计算出的匹配距离存在差异性和互补性。其差异性使得当样本被一个匹配距离错误判断时,另一个匹配距离可以补充进行准确地判断。此外,2种匹配距离的结合或将产生新的样本间的差异使得样本之间的差异更为明显。

图5 一维匹配距离的局限性

图6 单一匹配距离和二维匹配距离分隔效果比较

SVM的基本思想是求解能正确划分训练数据集和几何间隔距离最大的分离超平面,即使分离面最近的数据点之间距离最大。对于线性可分的数据集而言,划分的超平面有无穷多个(感知机),但是几何间隔最大的分离超平面却是唯一的。利用SVM的算法原理和公式。假设特征空间上的训练数据集为

为了解决这个优化问题,首先需要构造拉格朗日函数以得到其对偶问题,即

可化简得到

当对一个数据点进行分类时,只需将数据点放入()中,并将结果与符号进行比较,即

2.2 本文方法的总体流程

首先通过各个特征提取算法E提取每张图片的特征信息E,i,接着根据各自算法所提取的不同特征计算2张图片之间的匹配距离(E,i,E,j),然后将2张图片的不同匹配距离融合成多维匹配距离向量(,)用于分类

其中,E为第个特征提取算法;

E,i为用第个算法提取到第张图片的特征信息;

d为第个特征提取算法下,第和张图片之间的匹配距离;

D为第和张图片所构成的维匹配距离向量,也就是2.1中所定义的一个样本点。

理论上,该方法适用于二维至维匹配距离向量,其中为大于2的正整数。在实验中,具体选取了二维匹配距离至四维匹配距离3种不同的维度进行研究。类内样本的标签为1,类间样本的标签为0,从整个数据集中随机抽取一定数量的类间样本进行训练。

式(8)汇总了本文方法计算样本最终距离的3种情况,即

其中,和分别为第和张图像;

1和2分别为相应的类内和类间匹配的置信度分数;

1,2,···,d为根据各自特征提取算法计算的匹配距离;

1,2,···,为各个匹配距离的权重,且所有权重之和等于1。

3.1 指节纹数据库

本文所有的实验均在公共指节纹数据库PolyU-FKP数据库[13]上进行测试。一共选取了147人的左食指、左中指、右食指、右中指的图像,每根手指有12张图像,总计588类手指,7 056张指节纹图像。

3.2 参数与环境

实验中计算机配置环境为:Inter-Xeon E-2136CPU@3.30GHz16 GB内存,Matlab R2017B,Visual C++ 2015专业版。为了减少匹配时间,采用Matlab和C++混合编程。

3.3 实验结果

实验结果是通过接收机工作特性(receiver operating characteristic,ROC)曲线来描述各个算法的认证效果,曲线的横坐标表示真实接受率(geniune acceptance rate,GAR),曲线的纵坐标表示错误接受率(false acceptance rate,FAR)。评价指标还包括错误拒绝率(false rejection rate,FRR)和等错误率(equal error rate,EER),其是ROC曲线与=+1相交的横坐标。本文对8种经典编码类识别方法进行复现比较,分别为BOCV[15],ImComp[13],Comp[10],Magcode[13],DRCC[12],Ordinalcode[11],RCode1[14]和RCode2[14]。8种特征提取算法各自的EER见表1,同时图7展示了其ROC曲线。

表1 经典算法的EER (%)

图7 经典算法的ROC曲线比较

3.3.1 二维到四维的多维匹配距离

首先,将其中的2种匹配距离融合成二维匹配距离向量。表2展示了各组合使用该方法后的EER以及提升程度,提升程度指的是将各组合使用该方法后的EER与各组合中效果更好的一种匹配距离的EER进行比较。

表2 二维组合的EER及比较(%)

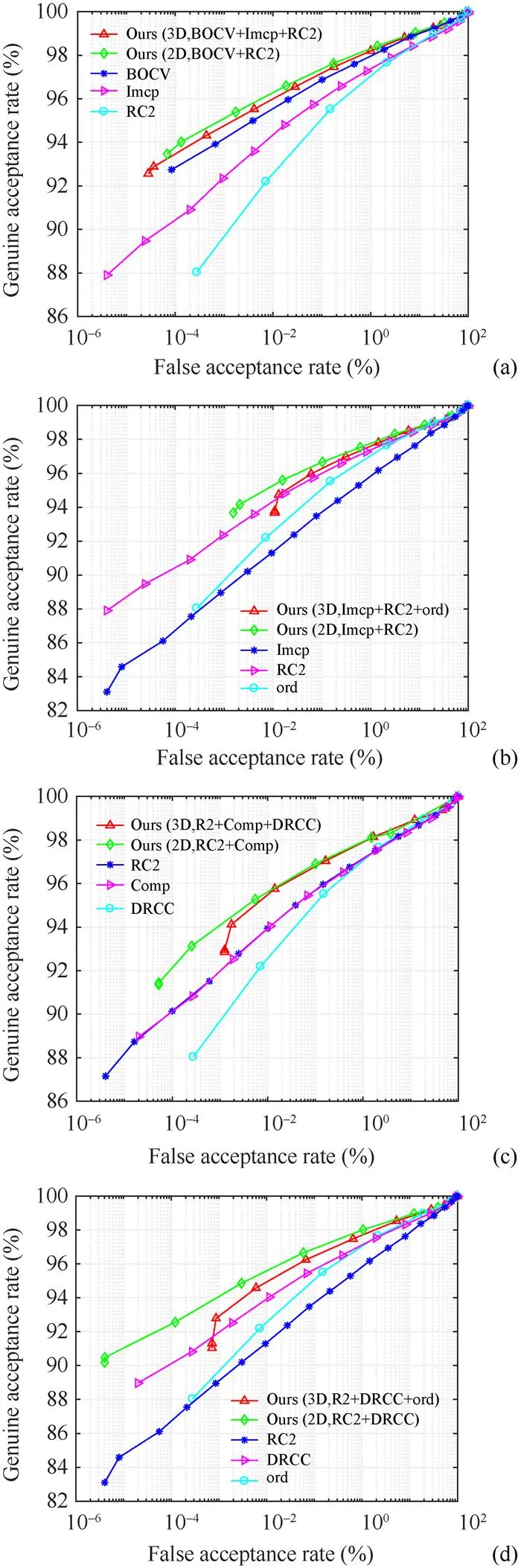

表2中的方法均可在一定程度上提高二维距离组合的性能,其中,RC2和Comp这组的EER下降程度高达21.03%。进一步的分析可发现Comp,RC1和RC2的3种算法的匹配距离均能很好地与其他匹配距离融合,算法之间较大的差异性是导致这一现象的根本原因。图8展示了部分二维组合使用本文方法后的ROC曲线,并与其各自组合中的2种匹配距离的ROC曲线进行比较。下文所有实验结果使用该方法均用Ours (xD,xxx+···+xxx)的形式表示,xD代表的是匹配距离的维数。

随后本文对3种匹配距离的特征融合的效果进行了研究,将3种不同的匹配距离融合成三维匹配距离向量,同样也在性能上取得了一定地提升。结合图9和表3比较了三维、二维和单个匹配距离的ROC曲线图,其中二维匹配距离是选取3种匹配距离中在上述二维实验中效果较好的一种。不难发现,在所有的组合情况中,三维匹配距离向量得到的鉴别性远好于任意一种匹配方法。然而,在和二维距离匹配方法相比则并不能达到更好的效果。

图8 二维及其对应一维ROC的比较

图9 三维、二维和一维ROC的比较

主要原因是对合理特征数量进行融合时,所融合出的有效判别信息远大于融合所产生噪声带来的精度损失;

相反的,当特征融合数量增多时,不同特征之间的差异性和互补性会越来越小,额外噪声信息所带来的精度损失会由于提取的不同特征之间相似度的提升而增多,特征融合带来的精度增益逐渐小于噪声带来的精度损失,以致出现维数增高后,效果不升反降的情况,因此3种匹配距离组合不及其中2种较好匹配距离组合所能得到的效果好。在先前的工作[19]中,也进行过类似的实验,发现了类似的现象,即随着特征融合数量的增多,噪声带来的精度损失逐渐超过精度增益,最终导致精度的下降。具体来说,三维特征组合的精度优于一维特征,而五维特征组合的精度却有部分不及三维特征组合。

表3 三维组合的EER(%)

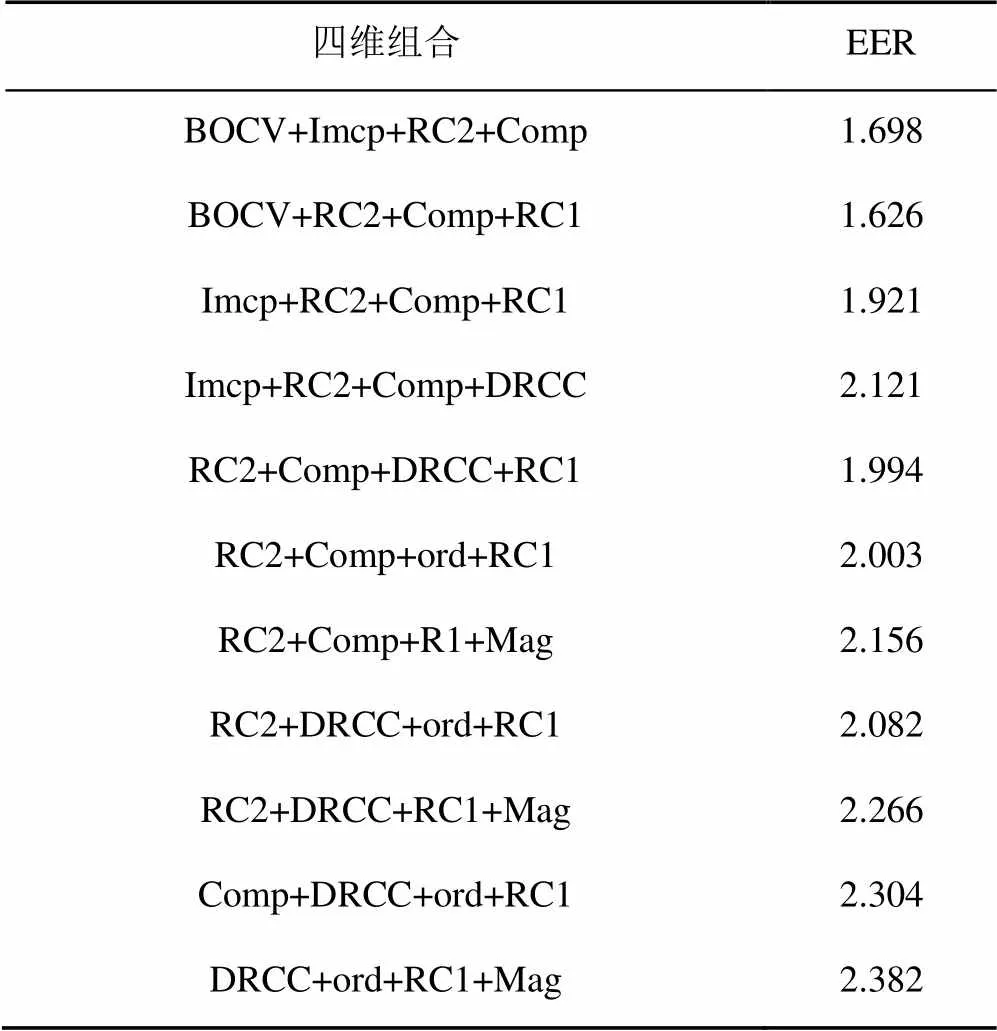

为了进一步验证,最后继续对四维匹配距离进行探究。表4列出了部分四维组合的结果,图10展示了2幅四维、三维和二维的ROC比较曲线,从中可以看出,使用该方法后四维匹配距离组合的结果优于组合中各个单维匹配距离的结果,且与对应较好的三维组合相比,四维组合的性能几乎没有什么变化。然而,四维组合的EER均高于相应的二维组合。

3.3.2 分数融合有效性验证

最后,为了验证分数融合的有效性,本文进行了更多的对比实验。为了体现鲁棒性和一般性,表5中将权重设置为0.5,对多组算法进行了性能提升比较和分析,图11中对2组算法分数融合中权重的敏感性进行了分析。

结合图11和表5前3行和后3行对比分析,2种特征相似时,分数融合可略微提升性能;

2种特征不同时,分数融合能够较为明显地提升性能。因此,无论哪种情况,分数融合在本文方法中是有效的。

表4 四维组合的EER (%)

图10 四维、三维和二维ROC的比较

表5 分数融合后的EER(%)

图11 权重x敏感性分析

3.4 小 结

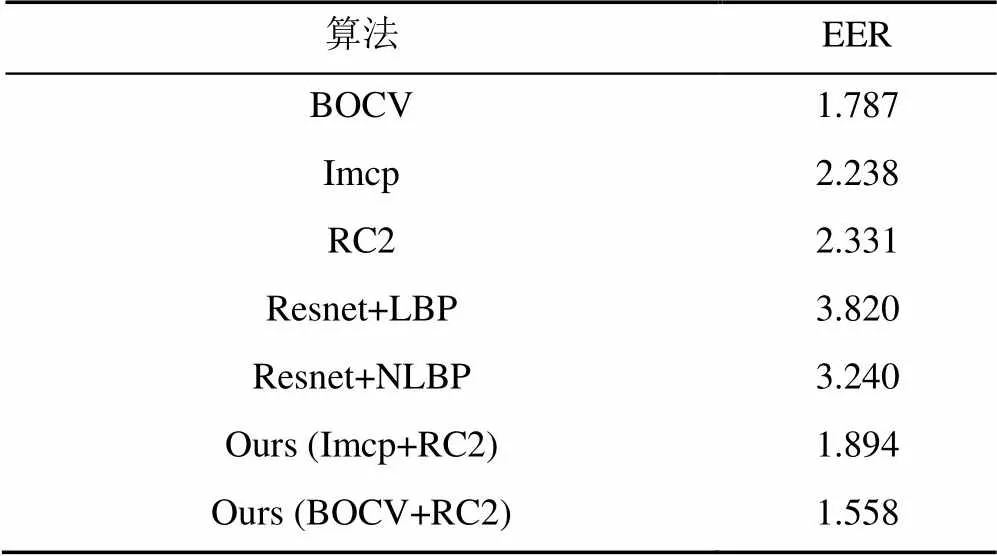

本文实验从3个不同维度探究了多维匹配距离融合的提升效果,结果表明二维匹配距离融合结果相比于其他维度具有最佳的性能。表6列出了2组本文算法与其他算法的比较。

表6 各类算法EER的比较(%)

本文提出了一种融合多种特征算法的匹配距离提高指节纹认证识别性能的方法。该方法主要利用不同特征提取算法计算出匹配距离之间的差异性和互补性,可有效地判决单一匹配距离无法判决的模糊样本,其具有极强的通用性,且易于嵌入到各种编码类方法中。

实验从二维至四维3种维度验证了本文方法的有效性。结果表明,多维匹配距离组合的性能优于对应的单一匹配距离,而二维匹配距离组合在多维匹配距离组中具有最好的性能。

本文方法在准确率和鲁棒性方面均可获得较优的效果。然而,总体效果在很大程度上是依赖于原有单个特征提取算法本身的精度,在未来的工作中,将针对指节纹特征提取算法进行更多深入研究,提升单个算法的精度,从而进一步提升该方法的效果。

[1] LENG L, YANG Z Y, MIN W D. Democratic voting downsampling for coding-based palmprint recognition[J]. IET Biometrics, 2020, 9(6): 290-296.

[2] LIM M H, YUEN P C. Entropy measurement for biometric verification systems[J]. IEEE Transactions on Cybernetics, 2016, 46(5): 1065-1077.

[3] FEI L K, LU G M, JIA W, et al. Feature extraction methods for palmprint recognition: a survey and evaluation[J]. IEEE Transactions on Systems, Man, and Cybernetics: Systems, 2019, 49(2): 346-363.

[4] YANG Z Y, LENG L, MIN W D. Extreme downsampling and joint feature for coding-based palmprint recognition[J]. IEEE Transactions on Instrumentation and Measurement, 2021, 70: 1-12.

[5] 于霞, 王玮. 内指节纹识别方法研究[J]. 信息与电脑: 理论版, 2020, 32(8): 115-117.

YU X, WANG W. Research on recognition method of internal finger knuckles[J]. China Computer & Communication, 2020, 32(8): 115-117 (in Chinese).

[6] LI S Y, ZHANG B, FEI L K, et al. Joint discriminative feature learning for multimodal finger recognition[J]. Pattern Recognition, 2021, 111: 107704.

[7] FEI L K, ZHANG B, TENG S H, et al. Joint multiview feature learning for hand-print recognition[J]. IEEE Transactions on Instrumentation and Measurement, 2020, 69(12): 9743-9755.

[8] 陆劲挺, 贾伟, 叶慧, 等. 指节纹识别综述[J]. 模式识别与人工智能, 2017, 30(7): 622-636.

LU J T, JIA W, YE H, et al. Finger-knuckle-print recognition: a preliminary review[J]. Pattern Recognition and Artificial Intelligence, 2017, 30(7): 622-636 (in Chinese).

[9] LI Q, QIU Z D, SUN D M, et al. Personal identification using knuckleprint[M]//Advances in Biometric Person Authentication. Heidelberg: Springer, 2004: 680-689.

[10] YANG W M, HUANG X L, ZHOU F, et al. Comparative competitive coding for personal identification by using finger vein and finger dorsal texture fusion[J]. Information Sciences, 2014, 268: 20-32.

[11] SUN Z N, TAN T N, WANG Y H, et al. Ordinal palmprint represention for personal identification[C]//2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2005: 279-284.

[12] XU Y, FEI L K, WEN J, et al. Discriminative and robust competitive code for palmprint recognition[J]. IEEE Transactions on Systems, Man, and Cybernetics: Systems, 2018, 48(2): 232-241.

[13] ZHANG L, ZHANG L, ZHANG D, et al. Online finger- knuckle-print verification for personal authentication[J]. Pattern Recognition, 2010, 43(7): 2560-2571.

[14] ZHANG L, LI H Y. Encoding local image patterns using Riesz transforms: with applications to palmprint and finger-knuckle-print recognition[J]. Image and Vision Computing, 2012, 30(12): 1043-1051.

[15] GUO Z H, ZHANG D, ZHANG L, et al. Palmprint verification using binary orientation co-occurrence vector[J]. Pattern Recognition Letters, 2009, 30(13): 1219-1227.

[16] TRABELSI S, SAMAI D, MERAOUMIA A, et al. Finger-knuckle-print recognition using deep convolutional neural network[C]//2020 1st International Conference on Communications, Control Systems and Signal Processing. New York: IEEE Press, 2020: 163-168.

[17] 罗威. 基于深度卷积网络和局部纹理描息融合的指节纹识别方法研究[D]. 合肥: 合肥工业大学, 2020.

LUO W. Research on finger-knuckle-print recognition based on fusion of basis and depth convolution network and local texture mapping[D]. Hefei: Hefei University of Technology, 2020 (in Chinese).

[18] NANNI L, LUMINI A. On selecting Gabor features for biometric authentication[J]. International Journal of Computer Applications in Technology, 2009, 35(1): 23.

[19] WEI X, WANG H, GUO G D, et al. Multiplex image representation for enhanced recognition[J]. International Journal of Machine Learning and Cybernetics, 2018, 9(3): 383-392.

Finger-knuckle-print recognition based on multi-dimensional matching distances fusion

HUANG Jie1, WEI Xin2, YANG Zi-yuan1, MIN Wei-dong2,3

(1. School of Information Engineering, Nanchang University, Nanchang Jiangxi 330031, China; 2. School of Software, Nanchang University, Nanchang Jiangxi 330047, China; 3. Jiangxi Key Laboratory of Smart City, Nanchang Jiangxi 330047, China)

As a novel biometric modality, finger-knuckle-print (FKP) recognition has gained much attention for its security and stability. Coding-based methods are considered as one of the most effective methods in this field. Such methods can distinguish samples according to one single matching distance between two images computed from the extracted features in the template matching stage. However, some fuzzy samples cannot be effectively distinguished by one single matching distance, leading to false acceptance and false rejection. To address this problem, a light-weight and effective method based on multi-dimensional matching distances fusion was proposed in this paper. The proposed method utilized the difference and complementarity between different matching distances of multiple coding-based methods, and applied support vector machine (SVM) to the classification of the multi-dimensional feature vectors constructed by the multiple matching distances. What’s more, the proposed method is a general method, which can be easily embedded into the existing coding-based methods. Extensive experiments were conducted for the range from two-dimensional matching distances to four-dimensional matching distances on the public FKP database, PolyU-FKP. The results have shown that the proposed method can generally improve their performances, with a maximum reduction of 22.19% in EER.

finger-knuckle-print recognition; multi-dimensional matching distances; difference complementarity; support vector machine; general method

TP 391

10.11996/JG.j.2095-302X.2022020279

A

2095-302X(2022)02-0279-09

2021-06-24;

2021-09-15

国家自然科学基金项目(62076117,61762061);

江西省自然科学基金重大项目(20161ACB20004);

江西省智慧城市重点实验室项目(20192BCD40002)

黄 杰(1997–),男,硕士研究生。主要研究方向为生物特征识别和计算机视觉。E-mail:jiehuang@email.ncu.edu.cn

闵卫东(1966–),男,教授,博士。主要研究方向为图形图像处理和计算机视觉等。E-mail:minweidong@ncu.edu.cn

24 June,2021;

15 September,2021

National Natural Science Foundation of China (62076117, 61762061); The Natural Science Foundation of Jiangxi Province, China (20161ACB20004); Jiangxi Key Laboratory of Smart City (20192BCD40002)

HUANG Jie (1997–), master student. His main research interests cover biometric identification and computer vision. E-mail:jiehuang@email.ncu.edu.cn

MIN Wei-dong (1966–), professor, Ph.D. His main research interests cover graphic image processing, computer vision, etc. E-mail:minweidong@ncu.edu.cn

猜你喜欢 特征提取编码向量 向量的分解新高考·高一数学(2022年3期)2022-04-28生活中的编码小学生学习指导(中年级)(2021年12期)2021-12-30聚焦“向量与三角”创新题中学生数理化(高中版.高考数学)(2021年1期)2021-03-19《全元诗》未编码疑难字考辨十五则汉字汉语研究(2020年2期)2020-08-13子带编码在图像压缩编码中的应用电子制作(2019年22期)2020-01-14空间目标的ISAR成像及轮廓特征提取北京航空航天大学学报(2019年9期)2019-10-26基于Gazebo仿真环境的ORB特征提取与比对的研究电子制作(2019年15期)2019-08-27基于特征提取的绘本阅读机器人设计方案电子制作(2019年15期)2019-08-27Genome and healthcare疯狂英语·新读写(2018年3期)2018-11-29基于MED—MOMEDA的风电齿轮箱复合故障特征提取研究电机与控制学报(2018年9期)2018-05-14